基于深度学习YOLOv10的小目标车辆检测系统(YOLOv10+YOLO数据集+UI界面+Python项目源码+模型)

本项目基于YOLOv10目标检测算法,开发了一套高效、精准的小目标车辆检测系统,专注于检测图像或视频中的小型车辆目标(如远距离车辆、密集车流中的小型车辆等)。系统采用优化的YOLOv10模型结构,结合针对小目标检测的数据增强策略,显著提升了模型对小尺寸车辆的识别能力。数据集包含7,481张车辆图像(训练集5,236张,验证集2,245张),涵盖不同光照条件、复杂背景、遮挡场景及多尺度车辆目标,确保

一、项目介绍

摘要

本项目基于YOLOv10目标检测算法,开发了一套高效、精准的小目标车辆检测系统,专注于检测图像或视频中的小型车辆目标(如远距离车辆、密集车流中的小型车辆等)。系统采用优化的YOLOv10模型结构,结合针对小目标检测的数据增强策略,显著提升了模型对小尺寸车辆的识别能力。

数据集包含7,481张车辆图像(训练集5,236张,验证集2,245张),涵盖不同光照条件、复杂背景、遮挡场景及多尺度车辆目标,确保模型在真实场景下的鲁棒性。该系统可广泛应用于智能交通监控、自动驾驶感知、无人机航拍车辆检测、停车场管理等场景,为智慧城市建设和交通管理提供关键技术支持。

项目意义

-

提升小目标检测精度

-

针对远距离、低分辨率或密集场景中的小型车辆,优化检测性能,减少漏检和误检。

-

适用于交通监控、无人机巡检等场景,弥补传统检测方法对小目标的识别不足。

-

-

智能交通与自动驾驶支持

-

为车路协同、自动驾驶感知系统提供高精度的车辆检测能力,提升道路安全性。

-

可用于交通流量统计、违章检测、事故预警等智慧交通应用。

-

-

无人机与遥感应用

-

适用于航拍、卫星图像中的车辆检测,助力智慧城市管理、军事侦察、灾害救援等场景。

-

-

计算效率优化

-

YOLOv10在保持高精度的同时优化计算效率,适用于边缘计算设备(如Jetson、树莓派)部署。

-

-

学术与工程价值

-

为小目标检测领域提供新的优化方案,推动YOLO系列算法在交通领域的应用落地。

-

目录

七、项目源码(视频下方简介内)

基于深度学习YOLOv10的小目标车辆检测系统(YOLOv10+YOLO数据集+UI界面+Python项目源码+模型) ————————————————_哔哩哔哩_bilibili

基于深度学习YOLOv10的小目标车辆检测系统(YOLOv10+YOLO数据集+UI界面+Python项目源码+模型) ————————————————

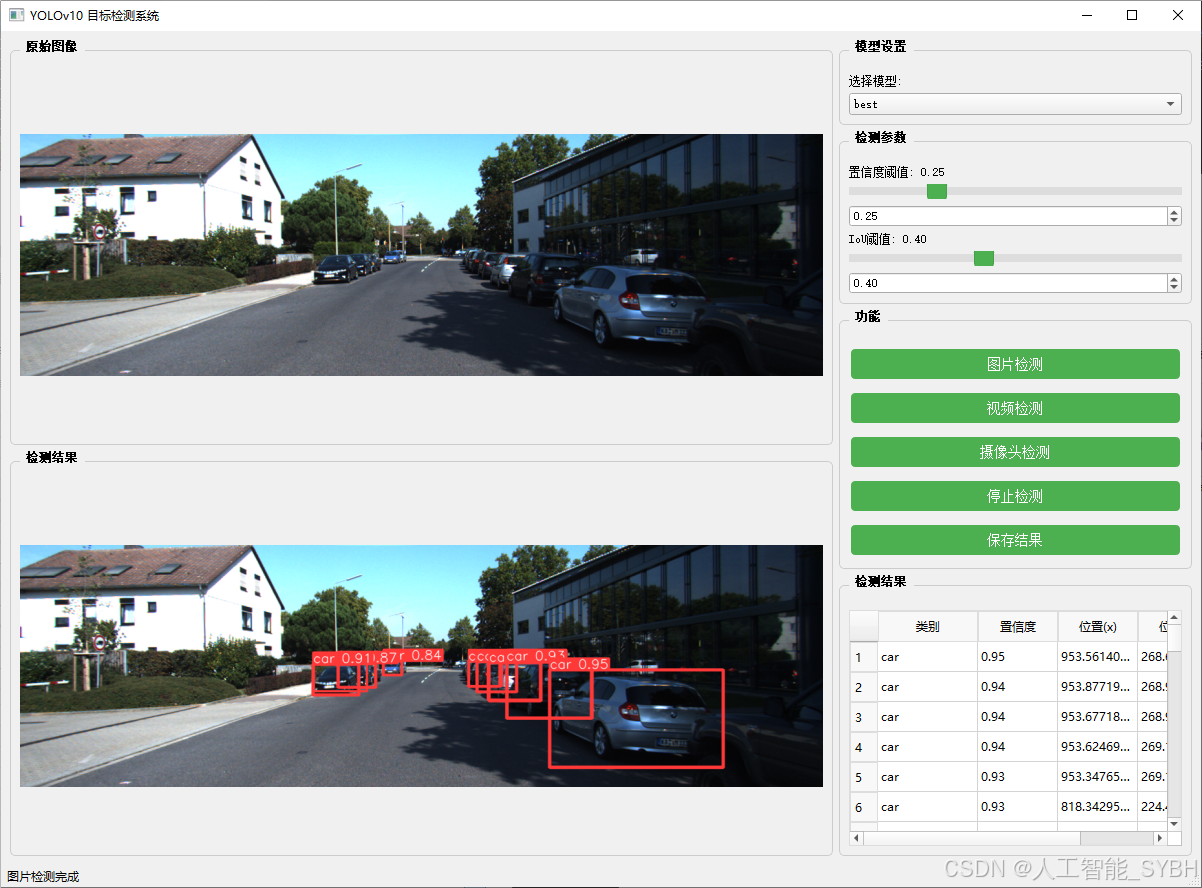

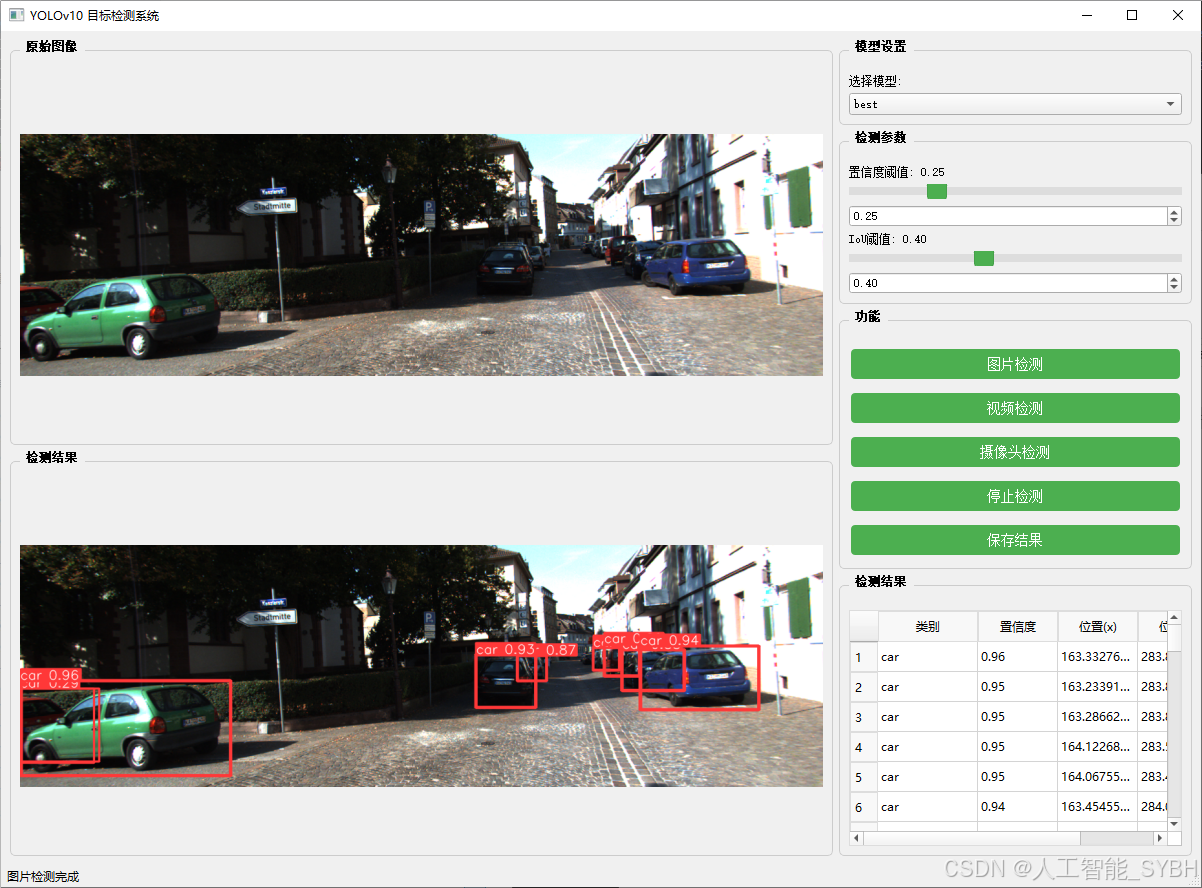

二、项目功能展示

系统功能

✅ 图片检测:可对图片进行检测,返回检测框及类别信息。

✅ 视频检测:支持视频文件输入,检测视频中每一帧的情况。

✅ 摄像头实时检测:连接USB 摄像头,实现实时监测。

✅参数实时调节(置信度和IoU阈值)

-

图片检测

该功能允许用户通过单张图片进行目标检测。输入一张图片后,YOLO模型会实时分析图像,识别出其中的目标,并在图像中框出检测到的目标,输出带有目标框的图像。

-

视频检测

视频检测功能允许用户将视频文件作为输入。YOLO模型将逐帧分析视频,并在每一帧中标记出检测到的目标。最终结果可以是带有目标框的视频文件或实时展示,适用于视频监控和分析等场景。

-

摄像头实时检测

该功能支持通过连接摄像头进行实时目标检测。YOLO模型能够在摄像头拍摄的实时视频流中进行目标检测,实时识别并显示检测结果。此功能非常适用于安防监控、无人驾驶、智能交通等应用,提供即时反馈。

核心特点:

- 高精度:基于YOLO模型,提供精确的目标检测能力,适用于不同类型的图像和视频。

- 实时性:特别优化的算法使得实时目标检测成为可能,无论是在视频还是摄像头实时检测中,响应速度都非常快。

- 批量处理:支持高效的批量图像和视频处理,适合大规模数据分析。

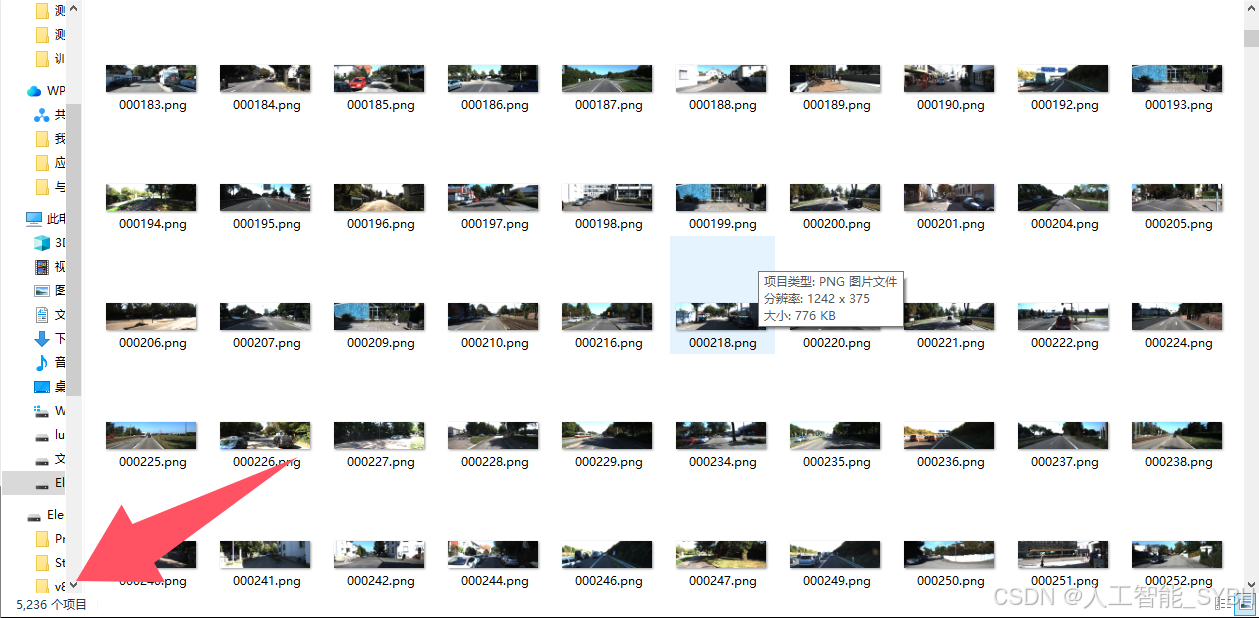

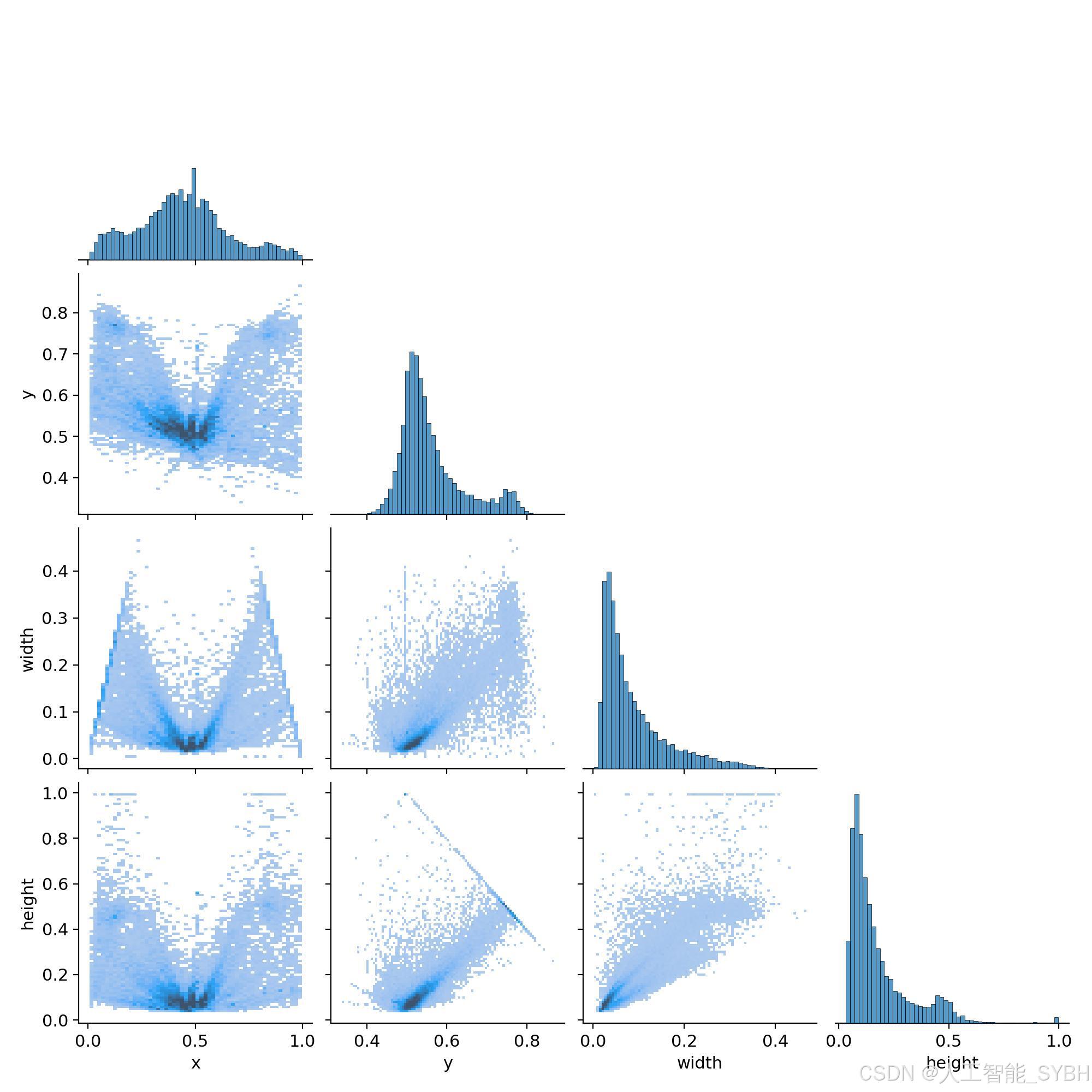

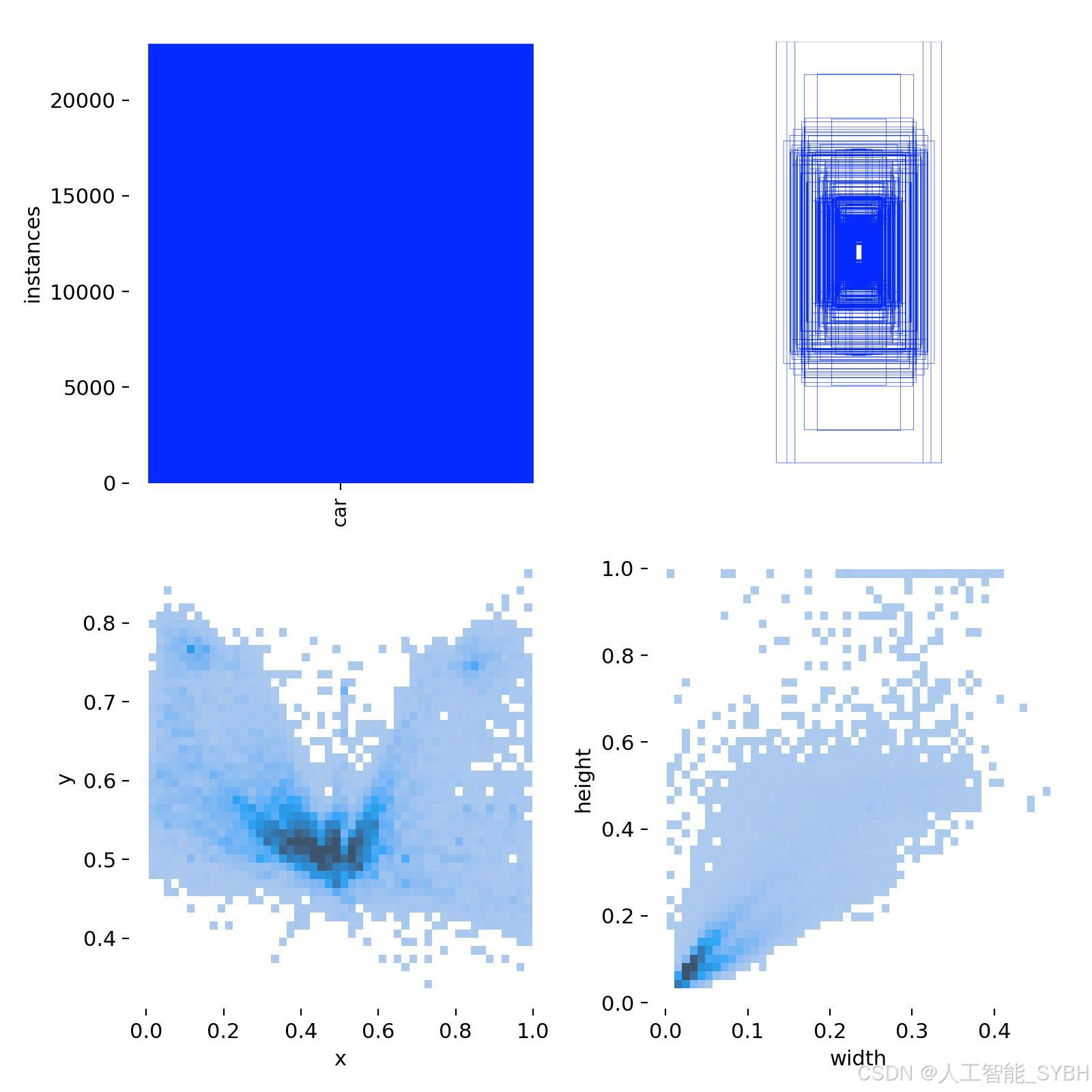

三、数据集介绍

数据集概述

本数据集专门针对小目标车辆检测任务构建,包含7,481张高质量标注图像,涵盖多种复杂场景(如城市道路、高速公路、停车场、航拍视角等)。数据经过严格筛选和增强,确保模型在不同环境下的泛化能力。

-

训练集:5,236张

-

验证集:2,245张

-

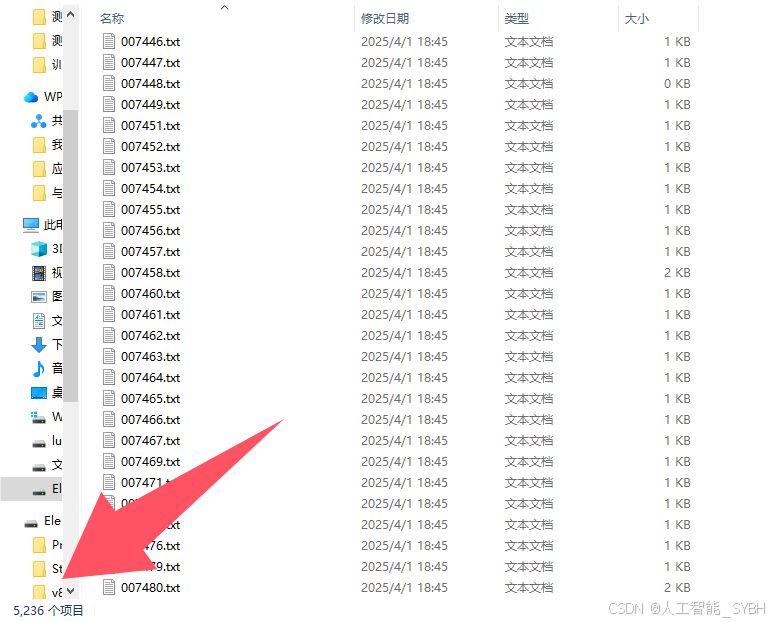

类别数(nc):1(仅检测车辆,适用于专注车辆识别的任务)

-

标注格式:YOLO格式(每张图像对应一个

.txt文件,存储归一化边界框坐标)

数据集特点

-

小目标占比高

-

数据集中包含大量远距离、低分辨率车辆目标,目标尺寸通常小于80×80像素,挑战模型对小目标的敏感度。

-

-

多样化场景

-

覆盖白天、夜间、雨天、雾天等多种光照和天气条件。

-

包含城市道路、高速公路、停车场、航拍视角等多种拍摄角度。

-

-

复杂背景与遮挡

-

部分车辆被树木、建筑物、其他车辆遮挡,模拟真实交通场景。

-

包含密集车流、交通拥堵等挑战性场景。

-

-

多尺度车辆

-

数据集中车辆尺寸差异大,涵盖近景大型车辆和远景小型车辆,提升模型多尺度适应能力。

-

-

高质量标注

-

采用人工+半自动标注,确保边界框精准贴合车辆轮廓。

-

标注经过交叉验证,减少错误标注。

-

数据集配置文件

采用标准YOLO格式,关键配置如下:

# YOLOv10 数据集配置文件

path: ./datasets/vehicle_detection/

train: images/train # 训练集路径

val: images/val # 验证集路径

nc: 1 # 类别数(仅车辆)

names: ['car'] # 类别名称数据集制作流程

-

数据采集

-

来源:公开数据集(如UA-DETRAC、COCO Vehicle)、无人机航拍、交通监控摄像头、自动驾驶仿真数据。

-

设备:高清摄像头、无人机、行车记录仪等。

-

场景覆盖:确保多样化,包括不同天气、光照、视角。

-

-

数据清洗

-

剔除模糊、过曝、低分辨率图像。

-

去除无车辆或标注错误的样本。

-

-

数据标注

-

使用LabelImg或CVAT工具进行边界框标注。

-

标注格式:

[class_id, x_center, y_center, width, height](归一化坐标)。 -

多人标注+交叉验证,确保标注一致性。

-

-

数据增强(提升小目标检测能力)

-

Mosaic增强:拼接多张图像,模拟密集小目标场景。

-

随机缩放:增强模型对不同尺寸车辆的适应能力。

-

CutMix:混合不同图像,提高遮挡情况下的检测鲁棒性。

-

光照调整:模拟不同天气(雾天、夜间低光)。

-

-

四、项目环境配置

创建虚拟环境

首先新建一个Anaconda环境,每个项目用不同的环境,这样项目中所用的依赖包互不干扰。

终端输入

conda create -n yolov10 python==3.9

激活虚拟环境

conda activate yolov10

安装cpu版本pytorch

pip install torch torchvision torchaudio

pycharm中配置anaconda

安装所需要库

pip install -r requirements.txt

五、模型训练

训练代码

from ultralytics import YOLOv10

model_path = 'yolov10s.pt'

data_path = 'datasets/data.yaml'

if __name__ == '__main__':

model = YOLOv10(model_path)

results = model.train(data=data_path,

epochs=500,

batch=64,

device='0',

workers=0,

project='runs/detect',

name='exp',

)根据实际情况更换模型 yolov10n.yaml (nano):轻量化模型,适合嵌入式设备,速度快但精度略低。 yolov10s.yaml (small):小模型,适合实时任务。 yolov10m.yaml (medium):中等大小模型,兼顾速度和精度。 yolov10b.yaml (base):基本版模型,适合大部分应用场景。 yolov10l.yaml (large):大型模型,适合对精度要求高的任务。

--batch 64:每批次64张图像。--epochs 500:训练500轮。--datasets/data.yaml:数据集配置文件。--weights yolov10s.pt:初始化模型权重,yolov10s.pt是预训练的轻量级YOLO模型。

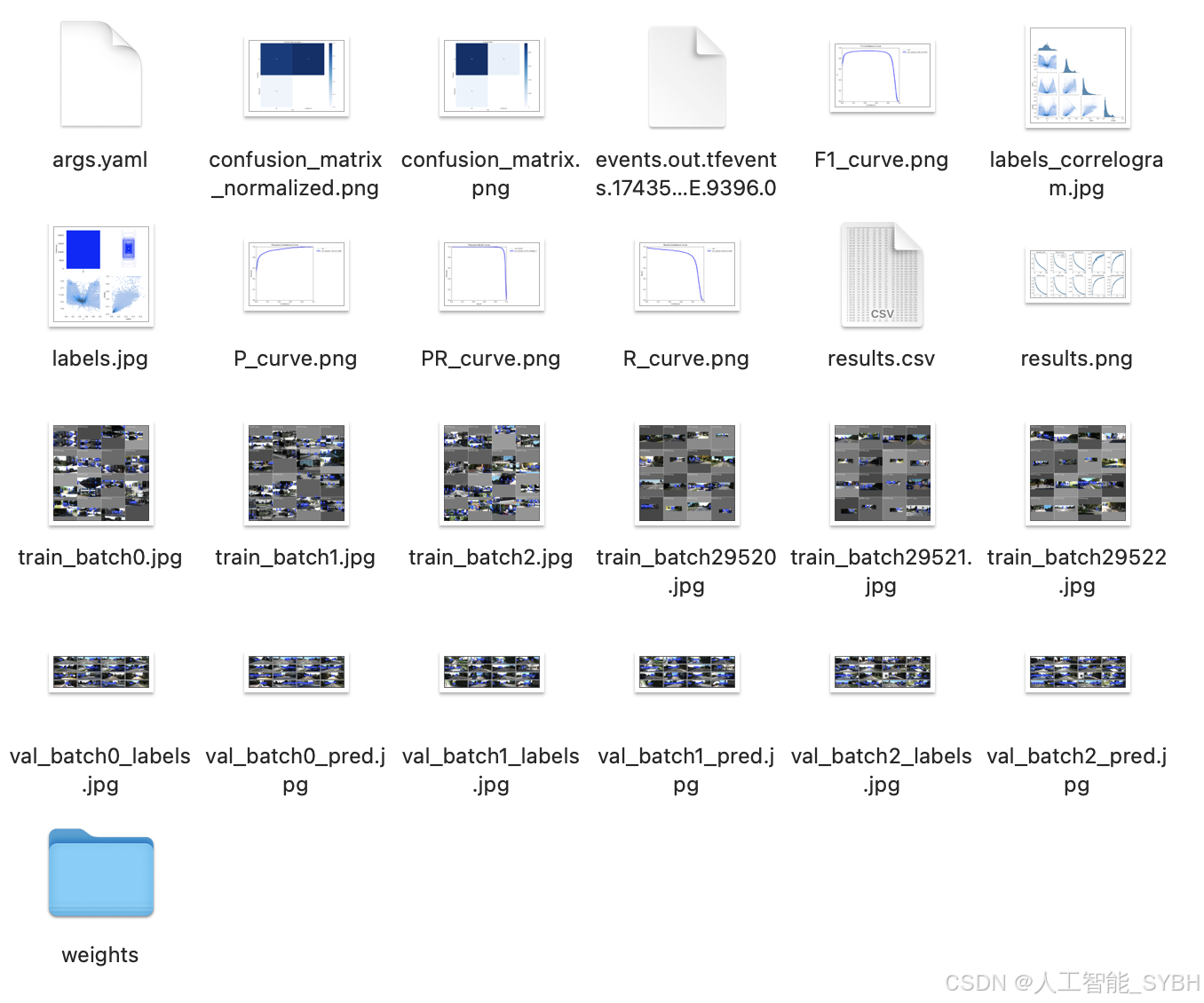

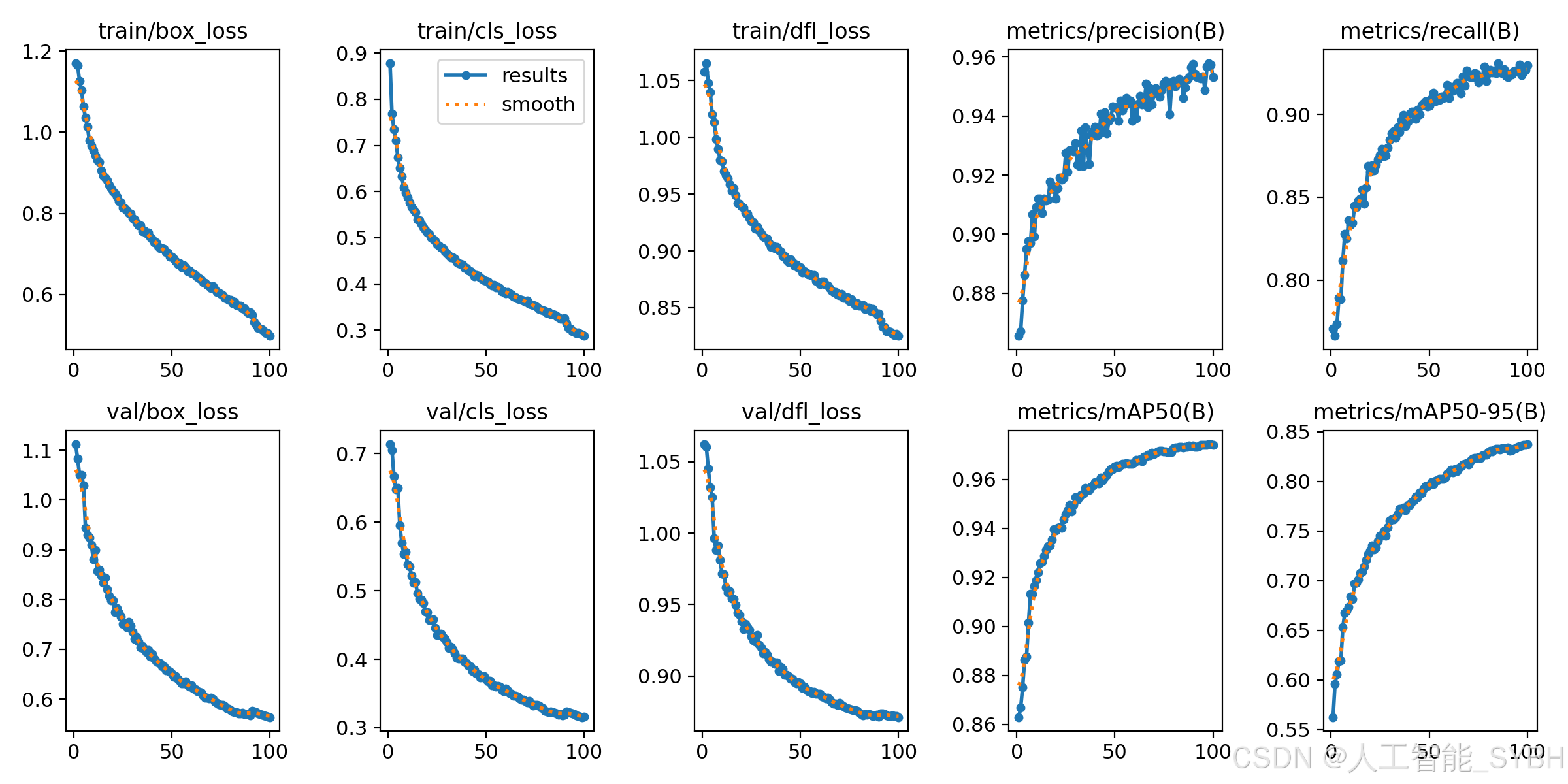

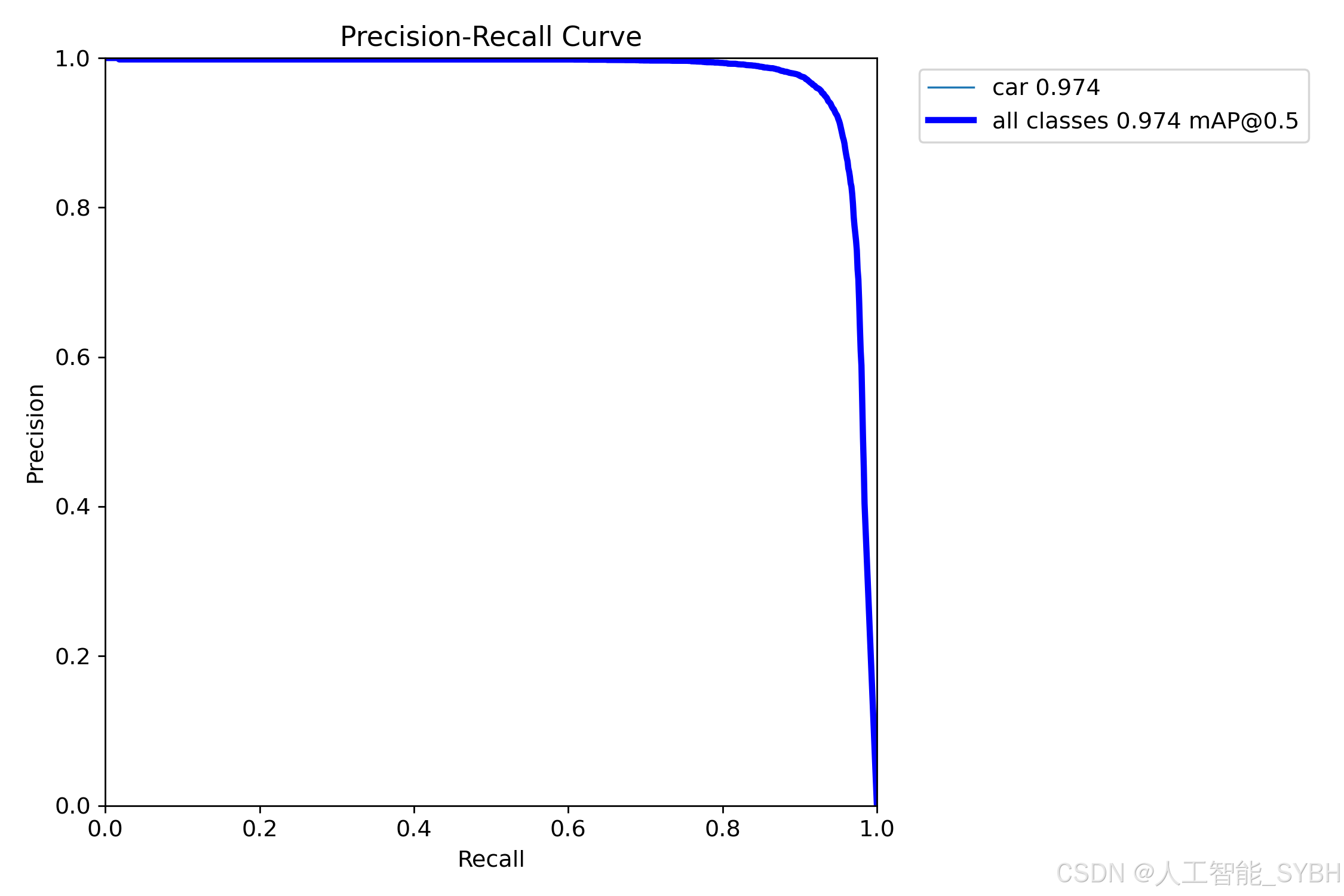

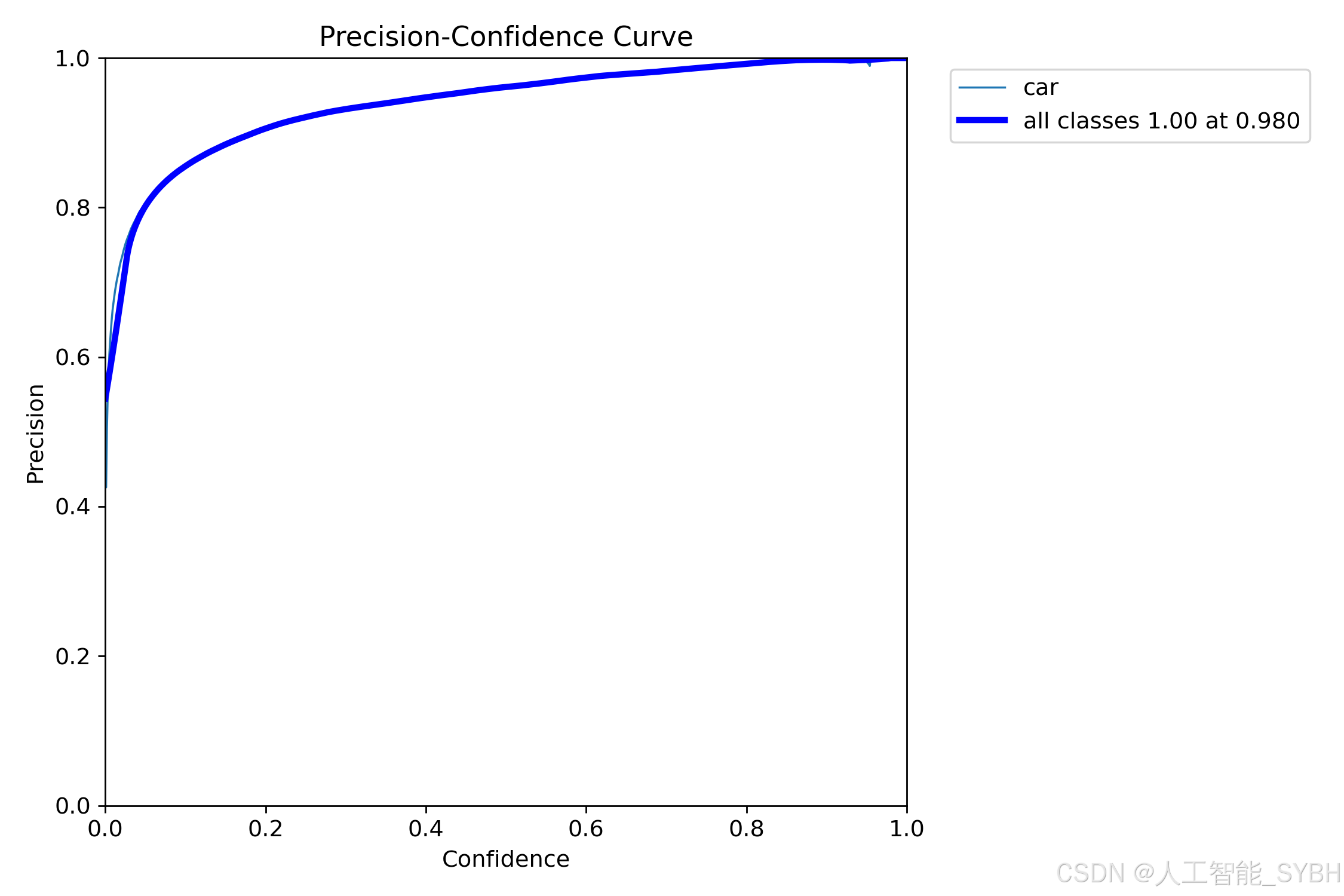

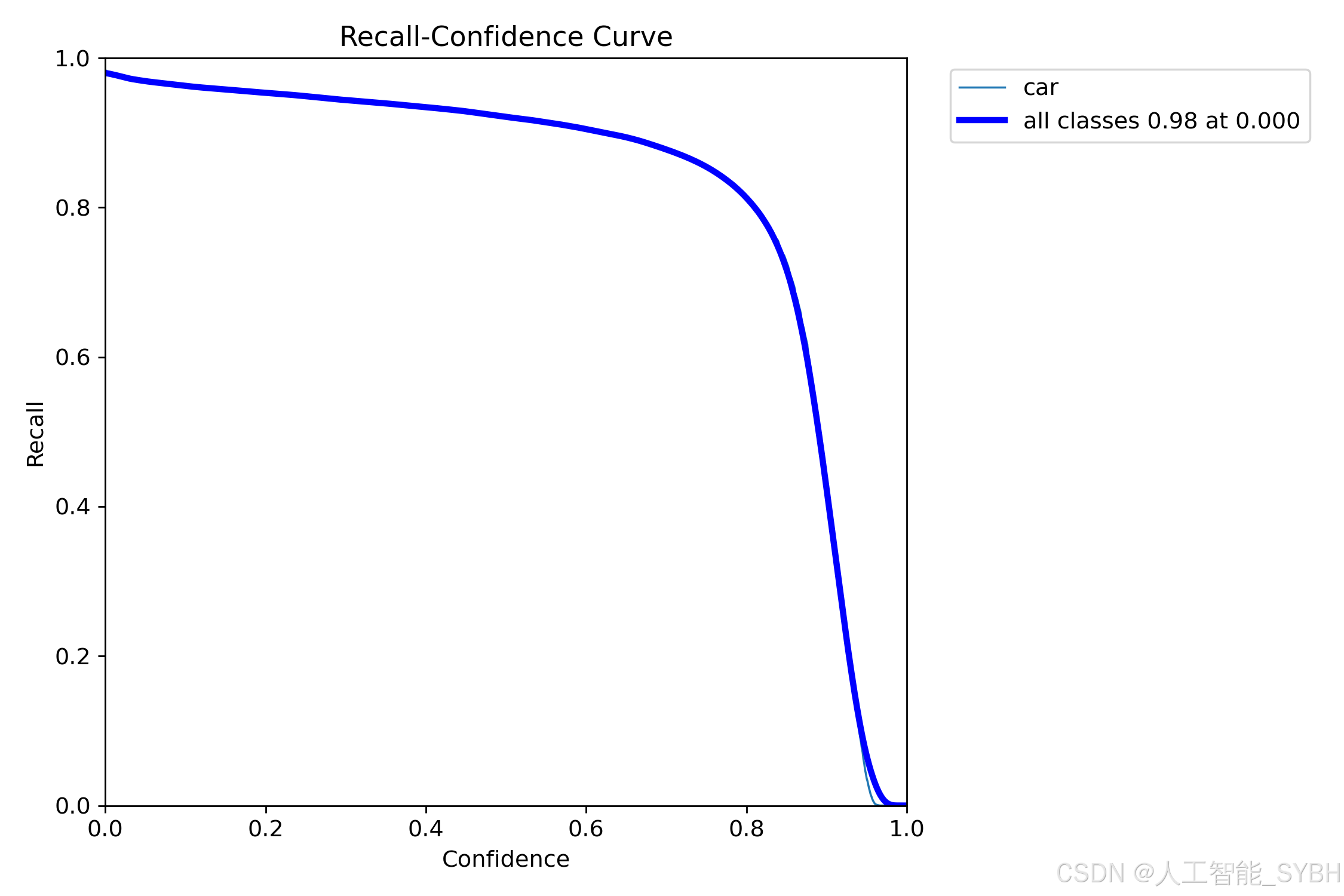

训练结果

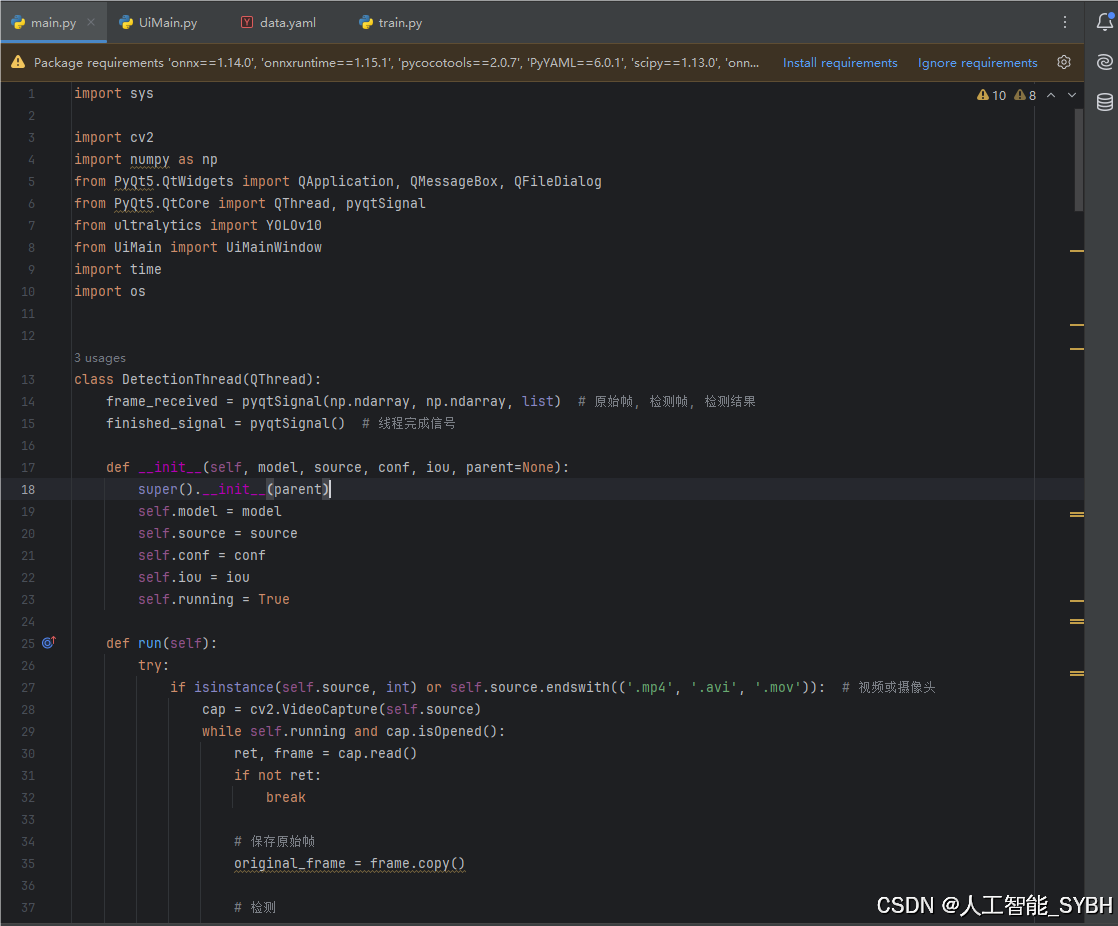

六、核心代码

import sys

import cv2

import numpy as np

from PyQt5.QtWidgets import QApplication, QMessageBox, QFileDialog

from PyQt5.QtCore import QThread, pyqtSignal

from ultralytics import YOLOv10

from UiMain import UiMainWindow

import time

import os

class DetectionThread(QThread):

frame_received = pyqtSignal(np.ndarray, np.ndarray, list) # 原始帧, 检测帧, 检测结果

finished_signal = pyqtSignal() # 线程完成信号

def __init__(self, model, source, conf, iou, parent=None):

super().__init__(parent)

self.model = model

self.source = source

self.conf = conf

self.iou = iou

self.running = True

def run(self):

try:

if isinstance(self.source, int) or self.source.endswith(('.mp4', '.avi', '.mov')): # 视频或摄像头

cap = cv2.VideoCapture(self.source)

while self.running and cap.isOpened():

ret, frame = cap.read()

if not ret:

break

# 保存原始帧

original_frame = frame.copy()

# 检测

results = self.model(frame, conf=self.conf, iou=self.iou)

annotated_frame = results[0].plot()

# 提取检测结果

detections = []

for result in results:

for box in result.boxes:

class_id = int(box.cls)

class_name = self.model.names[class_id]

confidence = float(box.conf)

x, y, w, h = box.xywh[0].tolist()

detections.append((class_name, confidence, x, y))

# 发送信号

self.frame_received.emit(

cv2.cvtColor(original_frame, cv2.COLOR_BGR2RGB),

cv2.cvtColor(annotated_frame, cv2.COLOR_BGR2RGB),

detections

)

# 控制帧率

time.sleep(0.03) # 约30fps

cap.release()

else: # 图片

frame = cv2.imread(self.source)

if frame is not None:

original_frame = frame.copy()

results = self.model(frame, conf=self.conf, iou=self.iou)

annotated_frame = results[0].plot()

# 提取检测结果

detections = []

for result in results:

for box in result.boxes:

class_id = int(box.cls)

class_name = self.model.names[class_id]

confidence = float(box.conf)

x, y, w, h = box.xywh[0].tolist()

detections.append((class_name, confidence, x, y))

self.frame_received.emit(

cv2.cvtColor(original_frame, cv2.COLOR_BGR2RGB),

cv2.cvtColor(annotated_frame, cv2.COLOR_BGR2RGB),

detections

)

except Exception as e:

print(f"Detection error: {e}")

finally:

self.finished_signal.emit()

def stop(self):

self.running = False

class MainWindow(UiMainWindow):

def __init__(self):

super().__init__()

# 初始化模型

self.model = None

self.detection_thread = None

self.current_image = None

self.current_result = None

self.video_writer = None

self.is_camera_running = False

self.is_video_running = False

self.last_detection_result = None # 新增:保存最后一次检测结果

# 连接按钮信号

self.image_btn.clicked.connect(self.detect_image)

self.video_btn.clicked.connect(self.detect_video)

self.camera_btn.clicked.connect(self.detect_camera)

self.stop_btn.clicked.connect(self.stop_detection)

self.save_btn.clicked.connect(self.save_result)

# 初始化模型

self.load_model()

def load_model(self):

try:

model_name = self.model_combo.currentText()

self.model = YOLOv10(f"{model_name}.pt") # 自动下载或加载本地模型

self.update_status(f"模型 {model_name} 加载成功")

except Exception as e:

QMessageBox.critical(self, "错误", f"模型加载失败: {str(e)}")

self.update_status("模型加载失败")

def detect_image(self):

if self.detection_thread and self.detection_thread.isRunning():

QMessageBox.warning(self, "警告", "请先停止当前检测任务")

return

file_path, _ = QFileDialog.getOpenFileName(

self, "选择图片", "", "图片文件 (*.jpg *.jpeg *.png *.bmp)")

if file_path:

self.clear_results()

self.current_image = cv2.imread(file_path)

self.current_image = cv2.cvtColor(self.current_image, cv2.COLOR_BGR2RGB)

self.display_image(self.original_image_label, self.current_image)

# 创建检测线程

conf = self.confidence_spinbox.value()

iou = self.iou_spinbox.value()

self.detection_thread = DetectionThread(self.model, file_path, conf, iou)

self.detection_thread.frame_received.connect(self.on_frame_received)

self.detection_thread.finished_signal.connect(self.on_detection_finished)

self.detection_thread.start()

self.update_status(f"正在检测图片: {os.path.basename(file_path)}")

def detect_video(self):

if self.detection_thread and self.detection_thread.isRunning():

QMessageBox.warning(self, "警告", "请先停止当前检测任务")

return

file_path, _ = QFileDialog.getOpenFileName(

self, "选择视频", "", "视频文件 (*.mp4 *.avi *.mov)")

if file_path:

self.clear_results()

self.is_video_running = True

# 初始化视频写入器

cap = cv2.VideoCapture(file_path)

frame_width = int(cap.get(cv2.CAP_PROP_FRAME_WIDTH))

frame_height = int(cap.get(cv2.CAP_PROP_FRAME_HEIGHT))

fps = cap.get(cv2.CAP_PROP_FPS)

cap.release()

# 创建保存路径

save_dir = "results"

os.makedirs(save_dir, exist_ok=True)

timestamp = time.strftime("%Y%m%d_%H%M%S")

save_path = os.path.join(save_dir, f"result_{timestamp}.mp4")

fourcc = cv2.VideoWriter_fourcc(*'mp4v')

self.video_writer = cv2.VideoWriter(save_path, fourcc, fps, (frame_width, frame_height))

# 创建检测线程

conf = self.confidence_spinbox.value()

iou = self.iou_spinbox.value()

self.detection_thread = DetectionThread(self.model, file_path, conf, iou)

self.detection_thread.frame_received.connect(self.on_frame_received)

self.detection_thread.finished_signal.connect(self.on_detection_finished)

self.detection_thread.start()

self.update_status(f"正在检测视频: {os.path.basename(file_path)}")

def detect_camera(self):

if self.detection_thread and self.detection_thread.isRunning():

QMessageBox.warning(self, "警告", "请先停止当前检测任务")

return

self.clear_results()

self.is_camera_running = True

# 创建检测线程 (默认使用摄像头0)

conf = self.confidence_spinbox.value()

iou = self.iou_spinbox.value()

self.detection_thread = DetectionThread(self.model, 0, conf, iou)

self.detection_thread.frame_received.connect(self.on_frame_received)

self.detection_thread.finished_signal.connect(self.on_detection_finished)

self.detection_thread.start()

self.update_status("正在从摄像头检测...")

def stop_detection(self):

if self.detection_thread and self.detection_thread.isRunning():

self.detection_thread.stop()

self.detection_thread.quit()

self.detection_thread.wait()

if self.video_writer:

self.video_writer.release()

self.video_writer = None

self.is_camera_running = False

self.is_video_running = False

self.update_status("检测已停止")

def on_frame_received(self, original_frame, result_frame, detections):

# 更新原始图像和结果图像

self.display_image(self.original_image_label, original_frame)

self.display_image(self.result_image_label, result_frame)

# 保存当前结果帧用于后续保存

self.last_detection_result = result_frame # 新增:保存检测结果

# 更新表格

self.clear_results()

for class_name, confidence, x, y in detections:

self.add_detection_result(class_name, confidence, x, y)

# 保存视频帧

if self.video_writer:

self.video_writer.write(cv2.cvtColor(result_frame, cv2.COLOR_RGB2BGR))

def on_detection_finished(self):

if self.video_writer:

self.video_writer.release()

self.video_writer = None

self.update_status("视频检测完成,结果已保存")

elif self.is_camera_running:

self.update_status("摄像头检测已停止")

else:

self.update_status("图片检测完成")

def save_result(self):

if not hasattr(self, 'last_detection_result') or self.last_detection_result is None:

QMessageBox.warning(self, "警告", "没有可保存的检测结果")

return

save_dir = "results"

os.makedirs(save_dir, exist_ok=True)

timestamp = time.strftime("%Y%m%d_%H%M%S")

if self.is_camera_running or self.is_video_running:

# 保存当前帧为图片

save_path = os.path.join(save_dir, f"snapshot_{timestamp}.jpg")

cv2.imwrite(save_path, cv2.cvtColor(self.last_detection_result, cv2.COLOR_RGB2BGR))

self.update_status(f"截图已保存: {save_path}")

else:

# 保存图片检测结果

save_path = os.path.join(save_dir, f"result_{timestamp}.jpg")

cv2.imwrite(save_path, cv2.cvtColor(self.last_detection_result, cv2.COLOR_RGB2BGR))

self.update_status(f"检测结果已保存: {save_path}")

def closeEvent(self, event):

self.stop_detection()

event.accept()

if __name__ == "__main__":

app = QApplication(sys.argv)

# 设置应用程序样式

app.setStyle("Fusion")

# 创建并显示主窗口

window = MainWindow()

window.show()

sys.exit(app.exec_())七、项目源码(视频下方简介内)

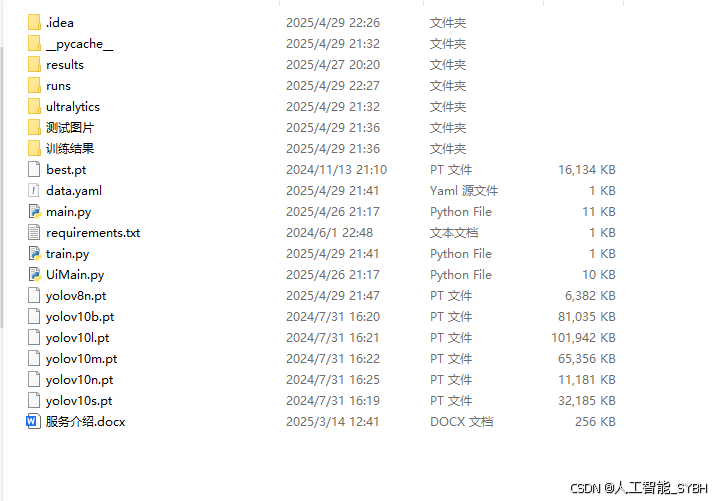

完整全部资源文件(包括测试图片、视频,py文件,训练数据集、训练代码、界面代码等),这里已打包上传至博主的面包多平台,见可参考博客与视频,已将所有涉及的文件同时打包到里面,点击即可运行,完整文件截图如下:

基于深度学习YOLOv10的小目标车辆检测系统(YOLOv10+YOLO数据集+UI界面+Python项目源码+模型) ————————————————_哔哩哔哩_bilibili

基于深度学习YOLOv10的小目标车辆检测系统(YOLOv10+YOLO数据集+UI界面+Python项目源码+模型) ————————————————

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)